Qwen3-Embedding- und Reranker-Modelle auf Ollama: State-of-the-Art-Leistung

Neue, hervorragende LLMs sind in Ollama verfügbar.

Die Qwen3 Embedding- und Reranker-Modelle sind die neuesten Veröffentlichungen in der Qwen-Familie und wurden speziell für fortgeschrittene Text-Einbettungs-, Abruf- und Neuklassifizierungsaufgaben entwickelt.

Eine Freude für die Augen

Die Qwen3 Embedding- und Reranker-Modelle stellen einen bedeutenden Fortschritt in der mehrsprachigen Verarbeitung natürlicher Sprache (NLP) dar und bieten ein branchenführendes Leistungsprofil bei Text-Einbettungs- und Neuklassifizierungsaufgaben. Diese Modelle, die Teil der von Alibaba entwickelten Qwen-Serie sind, wurden für eine breite Palette von Anwendungen konzipiert, von der semantischen Suche bis hin zur Code-Suche. Diese Art von Einbettungsfähigkeit ist grundlegend für den Aufbau effektiver RAG-Systeme, wie sie im Tutorial zu Retrieval-Augmented Generation (RAG): Architektur, Implementierung und Produktionsleitfaden detailliert beschrieben wird. Während Ollama eine beliebte Open-Source-Plattform für das Hosting und die Bereitstellung großer Sprachmodelle (LLMs) ist, wird die Integration der Qwen3-Modelle mit Ollama in der offiziellen Dokumentation nicht explizit detailliert beschrieben. Die Modelle sind jedoch über Hugging Face, GitHub und ModelScope verfügbar, was eine potenzielle lokale Bereitstellung über Ollama oder ähnliche Tools ermöglicht.

Beispiele für die Verwendung dieser Modelle

Bitte sehen Sie sich den Beispielcode in Go an, der Ollama mit diesen Modellen verwendet:

- Neuklassifizierung von Textdokumenten mit Ollama und dem Qwen3 Embedding-Modell - in Go

- Neuklassifizierung von Textdokumenten mit Ollama und dem Qwen3 Reranker-Modell - in Go

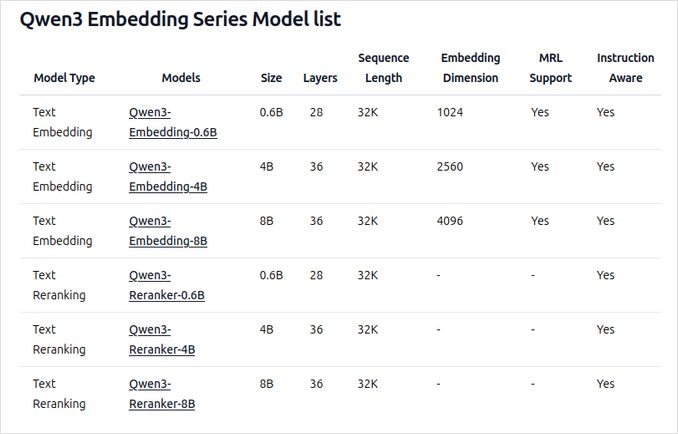

Überblick über die neuen Qwen3 Embedding- und Reranker-Modelle auf Ollama

Diese Modelle stehen nun in verschiedenen Größen für die Bereitstellung auf Ollama zur Verfügung und bieten branchenführende Leistung sowie Flexibilität für eine breite Palette von sprach- und codebezogenen Anwendungen.

Hauptmerkmale und Fähigkeiten

-

Modellgrößen und Flexibilität

- Verfügbar in mehreren Größen: 0,6 Mrd., 4 Mrd. und 8 Mrd. Parameter für sowohl Einbettungs- als auch Neuklassifizierungsaufgaben.

- Das 8-Milliarden-Einbettungsmodell rangiert derzeit auf Platz 1 der MTEB-Mehrsprachen-Bestenliste (Stand 5. Juni 2025 mit einer Punktzahl von 70,58).

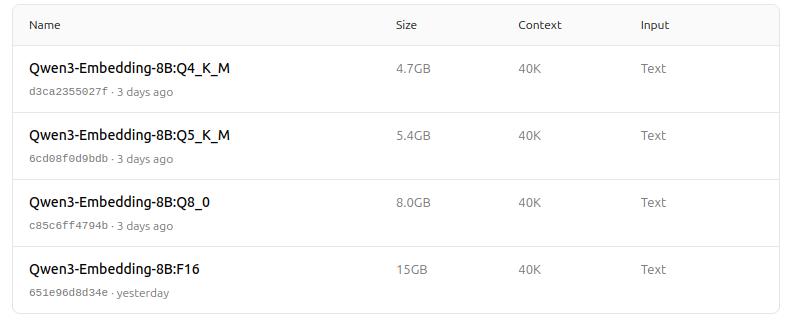

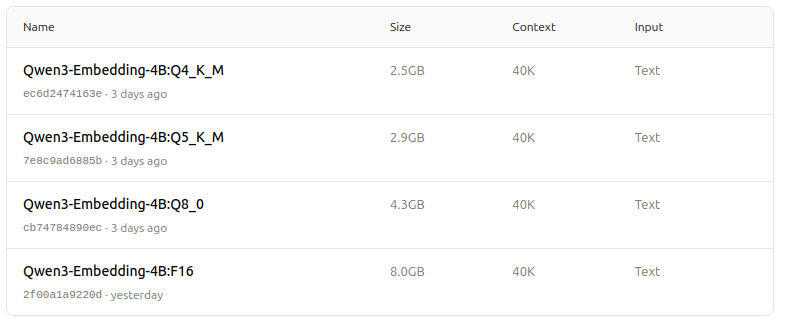

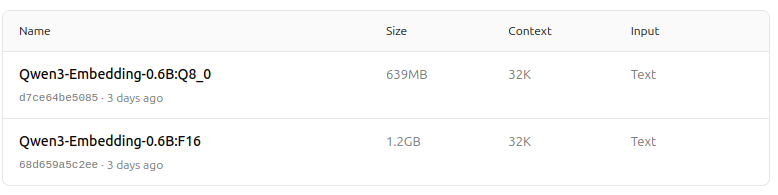

- Unterstützt eine Reihe von Quantisierungsoptionen (Q4, Q5, Q8 usw.), um Leistung, Speicherverbrauch und Geschwindigkeit auszugleichen. Q5_K_M wird für die meisten Nutzer empfohlen, da es die meiste Modellleistung bewahrt, während es ressourcenschonend ist.

-

Architektur und Training

- Basierend auf dem Qwen3-Fundament und nutzt sowohl Dual-Encoder- (für Einbettungen) als auch Cross-Encoder-Architekturen (für Neuklassifizierung).

- Einbettungsmodell: Verarbeitet einzelne Textsegmente und extrahiert semantische Darstellungen aus dem finalen versteckten Zustand.

- Reranker-Modell: Nimmt Textpaare (z. B. Abfrage und Dokument) entgegen und gibt einen Relevanzwert unter Verwendung eines Cross-Encoder-Ansatzes aus.

- Einbettungsmodelle verwenden ein dreistufiges Trainingsparadigma: kontrastives Pre-Training, überwachtes Training mit hochwertigen Daten und Modellverschmelzung für optimale Generalisierung und Anpassungsfähigkeit.

- Reranker-Modelle werden direkt mit hochwertigen, gelabelten Daten für maximale Effizienz und Wirksamkeit trainiert.

-

Mehrsprachige und Multitask-Unterstützung

- Unterstützt über 100 Sprachen, einschließlich Programmiersprachen, was robuste mehrsprachige, übergreifende und codebezogene Abruffähigkeiten ermöglicht.

- Einbettungsmodelle erlauben flexible Vektordefinitionen und benutzerdefinierte Anweisungen, um die Leistung an spezifische Aufgaben oder Sprachen anzupassen.

- Für Anwendungen, die über Text hinausgehende multimodale Fähigkeiten erfordern, siehe Cross-Modal-Einbettungen: Brückenschlag zwischen KI-Modalitäten.

-

Leistung und Anwendungsfälle

- Branchenführende Ergebnisse in der Textsuche, Code-Suche, Klassifizierung, Clusterbildung und Bitext-Mining.

- Reranker-Modelle zeichnen sich in verschiedenen Textsuchszenarien aus und können nahtlos mit Einbettungsmodellen für End-to-End-Abrufpipelines kombiniert werden.

Verwendung auf Ollama

Sie können diese Modelle auf Ollama mit Befehlen wie diesen ausführen:

ollama run dengcao/Qwen3-Embedding-8B:Q5_K_M

ollama run dengcao/Qwen3-Reranker-0.6B:F16

Wählen Sie die Quantisierungsversion, die am besten zu Ihren Hardware- und Leistungsanforderungen passt.

Update Dezember 2025: Nun stellt Ollama Standard-Qwen3-Einbettungsmodelle aus seinem eigenen Repository bereit, nicht aus dem von dengcao:

ollama pull qwen3-embedding:8b

ollama pull qwen3-embedding:4b

Mehr dazu: https://ollama.com/library/qwen3-embedding

Zusammenfassungstabelle

| Modelltyp | Verfügbare Größen | Hauptstärken | Mehrsprachige Unterstützung | Quantisierungsoptionen |

|---|---|---|---|---|

| Einbettung | 0.6B, 4B, 8B | Top-MTEB-Punktzahlen, flexibel, effizient, SOTA | Ja (100+ Sprachen) | Q4, Q5, Q6, Q8, etc. |

| Neuklassifizierer | 0.6B, 4B, 8B | Hervorragend bei Textpaar-Relevanz, effizient, flexibel | Ja | F16, Q4, Q5, etc. |

Fantastische Nachrichten!

Die Qwen3 Embedding- und Reranker-Modelle auf Ollama stellen einen bedeutenden Sprung in den mehrsprachigen, multitaskfähigen Text- und Code-Abruffähigkeiten dar. Mit flexiblen Bereitstellungsoptionen, starken Benchmark-Ergebnissen und der Unterstützung einer breiten Palette von Sprachen und Aufgaben sind sie sowohl für Forschungsumgebungen als auch für den produktiven Einsatz gleichermaßen gut geeignet.

Modellzoo – nun eine Freude für die Augen

Qwen3 Einbettung

https://ollama.com/dengcao/Qwen3-Embedding-8B

https://ollama.com/dengcao/Qwen3-Embedding-4B/tags

https://ollama.com/dengcao/Qwen3-Embedding-0.6B/tags

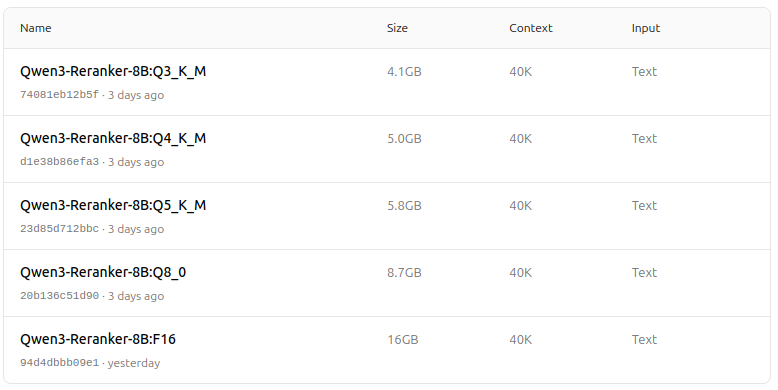

Qwen3 Neuklassifizierer

https://ollama.com/dengcao/Qwen3-Reranker-8B

dengcao/Qwen3-Reranker-8B:Q3_K_M

dengcao/Qwen3-Reranker-8B:Q5_K_M

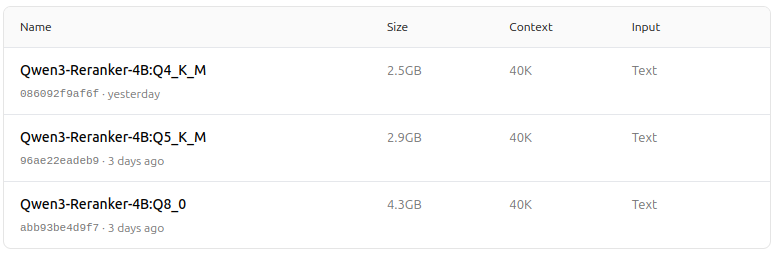

https://ollama.com/dengcao/Qwen3-Reranker-4B/tags

dengcao/Qwen3-Reranker-4B:Q5_K_M

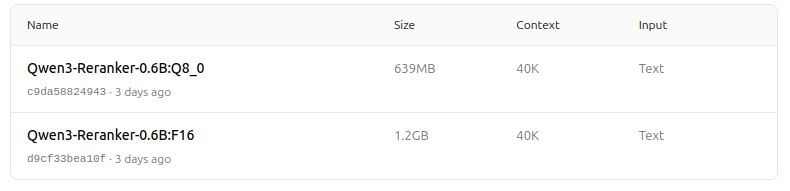

https://ollama.com/dengcao/Qwen3-Reranker-0.6B/tags

Schön!

Nützliche Links

- Neuklassifizierung von Textdokumenten mit Ollama und dem Qwen3 Embedding-Modell - in Go

- Neuklassifizierung von Textdokumenten mit Ollama und dem Qwen3 Reranker-Modell - in Go

- Ollama CheatSheet

- Ollama-Modelle auf einen anderen Laufwerk oder Ordner verschieben

- Selbst gehostetes Perplexica - mit Ollama

- Test: Wie Ollama Intel-CPU-Leistung und effiziente Kerne nutzt

- LLM-Geschwindigkeitsvergleich

- Vergleich der Zusammenfassungsfähigkeiten von LLMs

- Cloud-LLM-Anbieter

- Wie Ollama parallele Anfragen handhabt

- Vergleich der Hugo-Seiten-Übersetzungsqualität - LLMs auf Ollama